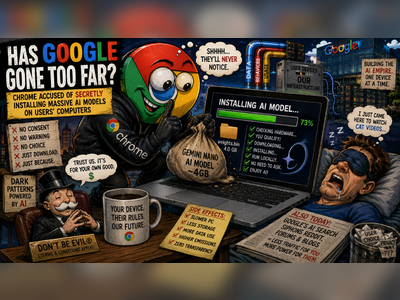

Hat Google zu weit gegangen? Chrome wird beschuldigt, heimlich massive KI-Modelle auf den Computern der Nutzer zu installieren.

Seit Jahren versprechen die größten Technologieunternehmen der Welt, dass Künstliche Intelligenz unsere Geräte intelligenter, schneller und persönlicher machen wird. Was sie nur selten thematisierten, war, wie ruhig diese Transformation geschehen würde — oder wie wenig Kontrolle die Nutzer letztlich über die Maschinen behalten könnten, die sie angeblich besitzen.

Jetzt entsteht eine wachsende Gegenreaktion gegen die Vorwürfe, dass Googles Chrome-Browser begonnen hat, automatisch große KI-Modelle auf die Computer der Nutzer herunterzuladen, ohne klare Zustimmung, ausdrückliche Genehmigung oder sogar offensichtliche Benachrichtigung.

Die Kontroversen haben eine tiefere und zunehmend unangenehme Frage, die im Herzen der KI-Revolution steht, neu entfacht: Wann haben Verbraucher aufgehört, gefragt zu werden, bevor ihre Computer in die Infrastruktur für die Ambitionen von Silicon Valley umgewandelt wurden?

Die Vorwürfe stammen von dem Sicherheitsforscher Alexander Hanff, der online weithin als „That Privacy Guy“ bekannt ist und eine detaillierte technische Analyse veröffentlicht hat, in der er behauptet, dass Chrome stillschweigend ein lokales KI-Modell herunterlädt, das mit Googles Gemini Nano-System verbunden ist.

Laut Hanff kann die Datei — angeblich weights.bin genannt — eine Größe von etwa vier Gigabyte erreichen und wird automatisch auf Maschinen installiert, die bestimmte Hardwareanforderungen erfüllen.

Vier Gigabyte sind kein triviales Hintergrund-Update.

Bis vor kurzem war dieser Grad des Speicherverbrauchs mit großen Softwarepaketen oder modernen Videospielen assoziiert und nicht mit einem Webbrowser, der hauptsächlich zum Öffnen von Tabs und zum Streamen von Videos verwendet wird.

Doch Hanff behauptet, der Prozess finde unsichtbar im Hintergrund während gewöhnlicher Browsing-Sitzungen statt, ohne sinnvolle Offenlegung und ohne ein einfaches Opt-in-System.

Noch alarmierender, argumentiert er, ist die Persistenz der Installation.

Nutzer, die die Datei manuell finden und löschen, könnten später feststellen, dass sie nach einem weiteren Chrome-Einsatzstill leise wieder auftaucht.

Laut seinen Erkenntnissen könnte das vollständige Verhindern des Downloads das Deaktivieren bestimmter Browserfunktionen tief im Chrome-Einstellungsmenü oder das Entfernen des Browsers insgesamt erfordern.

Um seine Behauptungen zu testen, führte Hanff, was er als kontrolliertes Experiment auf macOS beschreibt, unter Verwendung eines komplett frischen Chrome-Profils durch.

Während er das Journaling-Dateisystem des Betriebssystems überwachte - ein unabhängiger Protokollmechanismus, der Dateiativität unabhängig von Anwendungsberichten aufzeichnet - beobachtete er, wie Chrome Verzeichnisse erstellte, die mit KI-Infrastruktur verbunden sind, und das Modell im Hintergrund über einen Zeitraum von etwa vierzehn Minuten herunterlud.

Der Browser, so behauptet er, bewertete zuerst die Hardwarefähigkeiten des Geräts, bevor er entschied, ob es für den Betrieb eines lokalen KI-Modells geeignet war.

Praktisch gesehen wartete Chrome angeblich nicht darauf, dass die Nutzer KI-Tools aktivieren.

Stattdessen entschied es proaktiv, welche Computer auf gerätespezifische KI zugreifen konnten, und stellte die erforderliche Infrastruktur automatisch bereit.

Die Implikationen gehen weit über ein Browser-Update hinaus.

Im Zentrum der Kontroverse steht eine umfassendere Transformation, die die Technologieindustrie erfasst: die Migration künstlicher Intelligenz von entfernten Cloud-Servern direkt auf persönliche Geräte.

Unternehmen argumentieren, dass lokale KI-Modelle die Geschwindigkeit verbessern, die Serverkosten senken, den Datenschutz stärken und die Abhängigkeit von permanenter Internetverbindung verringern.

Googles Gemini Nano-Initiative ist speziell für diese Zukunft konzipiert - leichte KI-Systeme, die in der Lage sind, direkt auf Telefonen und Computern ohne ständige Kommunikation mit zentralisierten Datenzentren zu arbeiten.

Aus ingenieurtechnischer Perspektive ist die Logik überzeugend.

Aus der Perspektive der Nutzerrechte, so Kritiker, ist die Ausführung jedoch zutiefst bedenklich.

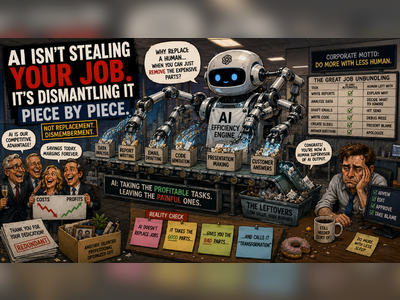

Hanff argumentiert, dass das Problem nicht nur technischer, sondern auch philosophischer Natur ist.

Seiner Ansicht nach behandeln Unternehmen zunehmend Verbrauchersysteme als Ziele für die Bereitstellung, anstatt als privat kontrolliertes Eigentum.

Funktionen werden standardmäßig aktiviert.

Hintergrundprozesse laufen stillschweigend ab.

Opt-out-Systeme sind in obskuren Menüs versteckt.

Und zunehmend entdecken Nutzer große Veränderungen erst, nachdem unabhängige Forscher sie aufgedeckt haben.

Die Kritik hallt wider in jahrelangen Beschwerden über sogenannte "Dark Patterns" - Schnittstellendesigns, die absichtlich so strukturiert sind, dass sie das Nutzerverhalten manipulieren, wichtige Informationen verbergen oder das Opt-out von Datensammlungen und Funktion aktivierung entmutigen.

Datenschutzbefürworter sagen, dass das KI-Zeitalter das Risiko birgt, diese Praktiken zu verstärken, indem große, maschinelles Lernen bedingte Infrastruktur direkt in die Verbraucherhardware eingebettet wird, unter dem Deckmantel nahtloser Bequemlichkeit.

Die rechtlichen Implikationen könnten ebenfalls explosiv werden.

Hanff argumentiert, dass die stille KI-Bereitstellung im Widerspruch zu europäischen Datenschutzrahmen wie der Datenschutz-Grundverordnung und der ePrivacy-Richtlinie stehen könnte, die strenge Regeln bezüglich der Zustimmung der Nutzer, Transparenz und lokalem Gerätespeicher auferlegen.

Europäische Regulierungsbehörden haben wiederholt Bereitschaft gezeigt, sich mit großen Technologieunternehmen über versteckte Verfolgungssysteme, aggressive Datenpraktiken und intransparente Zustimmungsströme auseinanderzusetzen.

Wenn Regulierungsbehörden feststellen, dass stille KI-Installationen bestehende Datenschutzgesetze verletzen, könnten die Konsequenzen für die Branche enorm sein.

Bis jetzt bleiben die Behauptungen Anschuldigungen von unabhängigen Forschern und wurden noch nicht vor Gericht geprüft.

Doch die Kontroversen kommen zu einem Zeitpunkt, an dem das öffentliche Vertrauen in große Technologieunternehmen bereits unter dem Gewicht ständiger KI-Expansion leidet.

Neben dem Datenschutz hebt Hanff auch eine weniger diskutierte Folge der lokalen KI-Bereitstellung hervor: die Belastung der Infrastruktur.

Für Nutzer in wohlhabenden urbanen Märkten, die mit unbegrenzten Glasfasernetzen verbunden sind, scheint ein vier Gigabyte großer Hintergrunddownload unbedeutend.

Aber Hunderte Millionen Menschen weltweit arbeiten weiterhin unter begrenzten Internetplänen, mobilen Hotspots, instabilen Infrastrukturen oder teuren Bandbreitenbeschränkungen.

Ein Browser, der leise Gigabytes an Daten verbraucht, kann zu echten finanziellen Kosten führen.

Dann gibt es die Umweltfrage.

Hanff schätzt, dass, wenn ähnliche Modelle auf Hunderten von Millionen von Geräten weltweit verteilt werden, der bloße Transfer dieser Dateien zehntausende Tonnen Kohlenstoffemissionen erzeugen könnte, bevor eine einzige KI-Funktion jemals aktiv genutzt wird.

In einer Zeit, in der Technologieunternehmen aggressiv Nachhaltigkeitsverpflichtungen und kohlenstoffneutrale Ambitionen vermarkten, sagen Kritiker, dass massenhaft unsichtbare Downloads einen wachsenden Widerspruch zwischen der Unternehmensumweltmarke und der Ressourcintensität der KI-Expansion aufzeigen.

Gleichzeitig formt Google einen weiteren Pfeiler des Internets aggressiv um: die Suche selbst.

Neben der Chrome-Kontroverse gab das Unternehmen bekannt, dass seine KI-gestützten Suchsysteme - einschließlich KI-Übersichten und KI-Modus - zunehmend Antworten integrieren werden, die aus Reddit-Diskussionen, Fachforen, persönlichen Blogs und sozialen Mediendiskussionen stammen.

Der Wandel spiegelt einen tiefgreifenden Wandel in der Art und Weise wider, wie Menschen online nach Informationen suchen.

In den letzten Jahren haben Nutzer zunehmend das Wort „Reddit“ an gewöhnliche Google-Suchen angehängt, getrieben von der Frustration, dass traditionelle Suchergebnisse mit Suchmaschinen-optimierten Marketinginhalten, Affiliate-Spam und generischen Artikeln, die hauptsächlich auf Werbeeinnahmen und nicht auf Nützlichkeit ausgerichtet sind, gesättigt sind.

Die Antwort von Google ist im Grunde ein Eingeständnis, dass die wertvollsten Informationen im Internet jetzt weniger in polierten Unternehmenswebsites und mehr in chaotischen öffentlichen Diskussionen zwischen gewöhnlichen Nutzern zu finden sind.

Unter dem neuen System plant Google, einen Abschnitt mit der Bezeichnung „Expertenrat“ einzuführen, der Kommentare, Benutzernamen, Gemeinschaftsdiskussionen und Forumantworten direkt in die KI-generierten Suchantworten einbindet.

Das Unternehmen wird auch mehr Links in den KI-Zusammenfassungen integrieren und längere Lesematerialien empfehlen, die mit der Anfrage verbunden sind.

Auf der Oberfläche scheint die Strategie praktisch zu sein.

Echte menschliche Gespräche liefern oft reichhaltigere, ehrliche Antworten als sterile SEO-Inhaltspools.

Aber der Schritt offenbart auch eine andere unbequeme Realität für Verlage und unabhängige Webseiten: Wenn Googles KI zunehmend in der Lage wird, Informationen direkt in Suchergebnisse zu synthetisieren, könnten weniger Nutzer das Bedürfnis verspüren, die originalen Webseiten überhaupt zu besuchen.

Die Internetwirtschaft wurde auf Traffic aufgebaut.

Die KI-Suche droht, dieses Ökosystem durch Extraktion zu ersetzen.

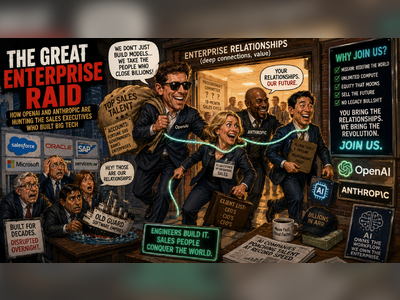

Was sich aus beiden Kontroversen ergibt - stille KI-Bereitstellung in Chrome und KI-generierte Suche, die aus Gemeinschaftsinhalten aufgebaut ist - ist ein Bild einer Branche, die mit atemberaubender Geschwindigkeit voranschreitet, während die öffentliche Aufsicht Mühe hat, Schritt zu halten.

Die gleichen Unternehmen, die einst Werkzeuge zum Navigieren des Internets entwickelt haben, redesignen jetzt die Architektur von Informationen, Datenverarbeitung und sogar von persönlichen Geräten selbst.

Und zunehmend scheinen sie bereit zu sein, es zuerst zu tun - und es später zu erklären.

Die Kontroversen haben eine tiefere und zunehmend unangenehme Frage, die im Herzen der KI-Revolution steht, neu entfacht: Wann haben Verbraucher aufgehört, gefragt zu werden, bevor ihre Computer in die Infrastruktur für die Ambitionen von Silicon Valley umgewandelt wurden?

Die Vorwürfe stammen von dem Sicherheitsforscher Alexander Hanff, der online weithin als „That Privacy Guy“ bekannt ist und eine detaillierte technische Analyse veröffentlicht hat, in der er behauptet, dass Chrome stillschweigend ein lokales KI-Modell herunterlädt, das mit Googles Gemini Nano-System verbunden ist.

Laut Hanff kann die Datei — angeblich weights.bin genannt — eine Größe von etwa vier Gigabyte erreichen und wird automatisch auf Maschinen installiert, die bestimmte Hardwareanforderungen erfüllen.

Vier Gigabyte sind kein triviales Hintergrund-Update.

Bis vor kurzem war dieser Grad des Speicherverbrauchs mit großen Softwarepaketen oder modernen Videospielen assoziiert und nicht mit einem Webbrowser, der hauptsächlich zum Öffnen von Tabs und zum Streamen von Videos verwendet wird.

Doch Hanff behauptet, der Prozess finde unsichtbar im Hintergrund während gewöhnlicher Browsing-Sitzungen statt, ohne sinnvolle Offenlegung und ohne ein einfaches Opt-in-System.

Noch alarmierender, argumentiert er, ist die Persistenz der Installation.

Nutzer, die die Datei manuell finden und löschen, könnten später feststellen, dass sie nach einem weiteren Chrome-Einsatzstill leise wieder auftaucht.

Laut seinen Erkenntnissen könnte das vollständige Verhindern des Downloads das Deaktivieren bestimmter Browserfunktionen tief im Chrome-Einstellungsmenü oder das Entfernen des Browsers insgesamt erfordern.

Um seine Behauptungen zu testen, führte Hanff, was er als kontrolliertes Experiment auf macOS beschreibt, unter Verwendung eines komplett frischen Chrome-Profils durch.

Während er das Journaling-Dateisystem des Betriebssystems überwachte - ein unabhängiger Protokollmechanismus, der Dateiativität unabhängig von Anwendungsberichten aufzeichnet - beobachtete er, wie Chrome Verzeichnisse erstellte, die mit KI-Infrastruktur verbunden sind, und das Modell im Hintergrund über einen Zeitraum von etwa vierzehn Minuten herunterlud.

Der Browser, so behauptet er, bewertete zuerst die Hardwarefähigkeiten des Geräts, bevor er entschied, ob es für den Betrieb eines lokalen KI-Modells geeignet war.

Praktisch gesehen wartete Chrome angeblich nicht darauf, dass die Nutzer KI-Tools aktivieren.

Stattdessen entschied es proaktiv, welche Computer auf gerätespezifische KI zugreifen konnten, und stellte die erforderliche Infrastruktur automatisch bereit.

Die Implikationen gehen weit über ein Browser-Update hinaus.

Im Zentrum der Kontroverse steht eine umfassendere Transformation, die die Technologieindustrie erfasst: die Migration künstlicher Intelligenz von entfernten Cloud-Servern direkt auf persönliche Geräte.

Unternehmen argumentieren, dass lokale KI-Modelle die Geschwindigkeit verbessern, die Serverkosten senken, den Datenschutz stärken und die Abhängigkeit von permanenter Internetverbindung verringern.

Googles Gemini Nano-Initiative ist speziell für diese Zukunft konzipiert - leichte KI-Systeme, die in der Lage sind, direkt auf Telefonen und Computern ohne ständige Kommunikation mit zentralisierten Datenzentren zu arbeiten.

Aus ingenieurtechnischer Perspektive ist die Logik überzeugend.

Aus der Perspektive der Nutzerrechte, so Kritiker, ist die Ausführung jedoch zutiefst bedenklich.

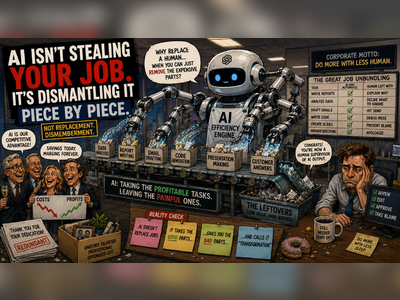

Hanff argumentiert, dass das Problem nicht nur technischer, sondern auch philosophischer Natur ist.

Seiner Ansicht nach behandeln Unternehmen zunehmend Verbrauchersysteme als Ziele für die Bereitstellung, anstatt als privat kontrolliertes Eigentum.

Funktionen werden standardmäßig aktiviert.

Hintergrundprozesse laufen stillschweigend ab.

Opt-out-Systeme sind in obskuren Menüs versteckt.

Und zunehmend entdecken Nutzer große Veränderungen erst, nachdem unabhängige Forscher sie aufgedeckt haben.

Die Kritik hallt wider in jahrelangen Beschwerden über sogenannte "Dark Patterns" - Schnittstellendesigns, die absichtlich so strukturiert sind, dass sie das Nutzerverhalten manipulieren, wichtige Informationen verbergen oder das Opt-out von Datensammlungen und Funktion aktivierung entmutigen.

Datenschutzbefürworter sagen, dass das KI-Zeitalter das Risiko birgt, diese Praktiken zu verstärken, indem große, maschinelles Lernen bedingte Infrastruktur direkt in die Verbraucherhardware eingebettet wird, unter dem Deckmantel nahtloser Bequemlichkeit.

Die rechtlichen Implikationen könnten ebenfalls explosiv werden.

Hanff argumentiert, dass die stille KI-Bereitstellung im Widerspruch zu europäischen Datenschutzrahmen wie der Datenschutz-Grundverordnung und der ePrivacy-Richtlinie stehen könnte, die strenge Regeln bezüglich der Zustimmung der Nutzer, Transparenz und lokalem Gerätespeicher auferlegen.

Europäische Regulierungsbehörden haben wiederholt Bereitschaft gezeigt, sich mit großen Technologieunternehmen über versteckte Verfolgungssysteme, aggressive Datenpraktiken und intransparente Zustimmungsströme auseinanderzusetzen.

Wenn Regulierungsbehörden feststellen, dass stille KI-Installationen bestehende Datenschutzgesetze verletzen, könnten die Konsequenzen für die Branche enorm sein.

Bis jetzt bleiben die Behauptungen Anschuldigungen von unabhängigen Forschern und wurden noch nicht vor Gericht geprüft.

Doch die Kontroversen kommen zu einem Zeitpunkt, an dem das öffentliche Vertrauen in große Technologieunternehmen bereits unter dem Gewicht ständiger KI-Expansion leidet.

Neben dem Datenschutz hebt Hanff auch eine weniger diskutierte Folge der lokalen KI-Bereitstellung hervor: die Belastung der Infrastruktur.

Für Nutzer in wohlhabenden urbanen Märkten, die mit unbegrenzten Glasfasernetzen verbunden sind, scheint ein vier Gigabyte großer Hintergrunddownload unbedeutend.

Aber Hunderte Millionen Menschen weltweit arbeiten weiterhin unter begrenzten Internetplänen, mobilen Hotspots, instabilen Infrastrukturen oder teuren Bandbreitenbeschränkungen.

Ein Browser, der leise Gigabytes an Daten verbraucht, kann zu echten finanziellen Kosten führen.

Dann gibt es die Umweltfrage.

Hanff schätzt, dass, wenn ähnliche Modelle auf Hunderten von Millionen von Geräten weltweit verteilt werden, der bloße Transfer dieser Dateien zehntausende Tonnen Kohlenstoffemissionen erzeugen könnte, bevor eine einzige KI-Funktion jemals aktiv genutzt wird.

In einer Zeit, in der Technologieunternehmen aggressiv Nachhaltigkeitsverpflichtungen und kohlenstoffneutrale Ambitionen vermarkten, sagen Kritiker, dass massenhaft unsichtbare Downloads einen wachsenden Widerspruch zwischen der Unternehmensumweltmarke und der Ressourcintensität der KI-Expansion aufzeigen.

Gleichzeitig formt Google einen weiteren Pfeiler des Internets aggressiv um: die Suche selbst.

Neben der Chrome-Kontroverse gab das Unternehmen bekannt, dass seine KI-gestützten Suchsysteme - einschließlich KI-Übersichten und KI-Modus - zunehmend Antworten integrieren werden, die aus Reddit-Diskussionen, Fachforen, persönlichen Blogs und sozialen Mediendiskussionen stammen.

Der Wandel spiegelt einen tiefgreifenden Wandel in der Art und Weise wider, wie Menschen online nach Informationen suchen.

In den letzten Jahren haben Nutzer zunehmend das Wort „Reddit“ an gewöhnliche Google-Suchen angehängt, getrieben von der Frustration, dass traditionelle Suchergebnisse mit Suchmaschinen-optimierten Marketinginhalten, Affiliate-Spam und generischen Artikeln, die hauptsächlich auf Werbeeinnahmen und nicht auf Nützlichkeit ausgerichtet sind, gesättigt sind.

Die Antwort von Google ist im Grunde ein Eingeständnis, dass die wertvollsten Informationen im Internet jetzt weniger in polierten Unternehmenswebsites und mehr in chaotischen öffentlichen Diskussionen zwischen gewöhnlichen Nutzern zu finden sind.

Unter dem neuen System plant Google, einen Abschnitt mit der Bezeichnung „Expertenrat“ einzuführen, der Kommentare, Benutzernamen, Gemeinschaftsdiskussionen und Forumantworten direkt in die KI-generierten Suchantworten einbindet.

Das Unternehmen wird auch mehr Links in den KI-Zusammenfassungen integrieren und längere Lesematerialien empfehlen, die mit der Anfrage verbunden sind.

Auf der Oberfläche scheint die Strategie praktisch zu sein.

Echte menschliche Gespräche liefern oft reichhaltigere, ehrliche Antworten als sterile SEO-Inhaltspools.

Aber der Schritt offenbart auch eine andere unbequeme Realität für Verlage und unabhängige Webseiten: Wenn Googles KI zunehmend in der Lage wird, Informationen direkt in Suchergebnisse zu synthetisieren, könnten weniger Nutzer das Bedürfnis verspüren, die originalen Webseiten überhaupt zu besuchen.

Die Internetwirtschaft wurde auf Traffic aufgebaut.

Die KI-Suche droht, dieses Ökosystem durch Extraktion zu ersetzen.

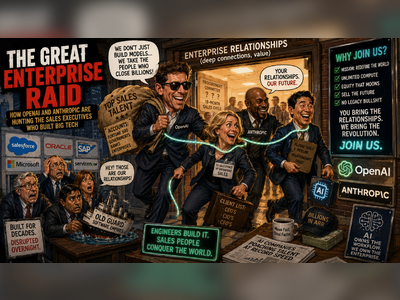

Was sich aus beiden Kontroversen ergibt - stille KI-Bereitstellung in Chrome und KI-generierte Suche, die aus Gemeinschaftsinhalten aufgebaut ist - ist ein Bild einer Branche, die mit atemberaubender Geschwindigkeit voranschreitet, während die öffentliche Aufsicht Mühe hat, Schritt zu halten.

Die gleichen Unternehmen, die einst Werkzeuge zum Navigieren des Internets entwickelt haben, redesignen jetzt die Architektur von Informationen, Datenverarbeitung und sogar von persönlichen Geräten selbst.

Und zunehmend scheinen sie bereit zu sein, es zuerst zu tun - und es später zu erklären.